- Retrait en 2 heures

- Assortiment impressionnant

- Paiement sécurisé

- Toujours un magasin près de chez vous

- Retrait en 2 heures

- Assortiment impressionnant

- Paiement sécurisé

- Toujours un magasin près de chez vous

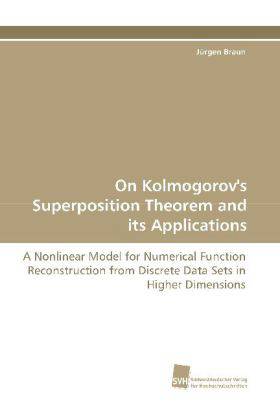

On Kolmogorov's Superposition Theorem and its Applications

A Nonlinear Model for Numerical Function Reconstruction from Discrete Data Sets in Higher Dimensions

Jürgen Braun

Livre broché | Anglais

78,95 €

+ 157 points

Description

We present a Regularization Network approach based on Kolmogorov's superposition theorem (KST) to reconstruct higher dimensional continuous functions from their function values on discrete data points. The ansatz is based on a new constructive proof of a version of the theorem. Additionally, the thesis gives a comprehensive overview on the various versions of KST that exist and its relation to well known approximation schemes and Neural Networks. The efficient representation of higher dimensional continuous functions as superposition of univariate continuous functions suggests the conjecture that in a reconstruction, the exponential dependency of the involved numerical costs on the dimensionality, the so-called curse of dimensionality, can be circumvented. However, this is not the case, since the involved univariate functions are either unknown or not smooth. Therefore, we develop a Regularization Network approach in a reproducing kernel Hilbert space setting such that the restriction of the underlying approximation spaces defines a nonlinear model for function reconstruction. Finally, a verification and analysis of the model is given by various numerical examples.

Spécifications

Parties prenantes

- Auteur(s) :

- Editeur:

Contenu

- Nombre de pages :

- 192

- Langue:

- Anglais

Caractéristiques

- EAN:

- 9783838116372

- Date de parution :

- 26-06-10

- Format:

- Livre broché

- Dimensions :

- 150 mm x 11 mm

- Poids :

- 272 g

Seulement chez Librairie Club

+ 157 points sur votre carte client de Librairie Club

Les avis

Nous publions uniquement les avis qui respectent les conditions requises. Consultez nos conditions pour les avis.